Die SEO-Potenziale 2016

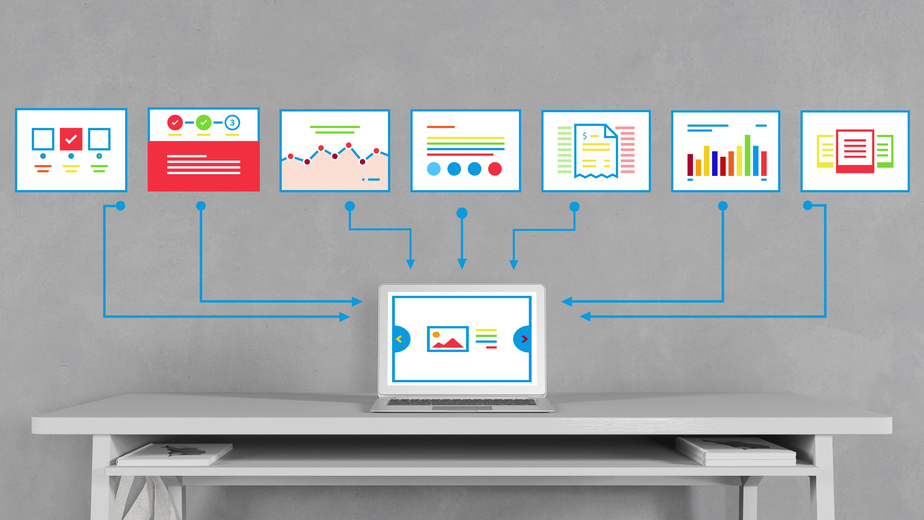

Der Weg vom Kunden zur Webseite oder zum Webshop ist im seltensten Fall geradlinig. In der Regel wird ein Zwischenstopp eingelegt und die Suchmaschine befragt, um eine Vorauswahl von geeigneten Seiten zu treffen. Will man als Inhaber einer solchen Webseite gefunden werden, kommt man um dessen Optimierung für die Suchmaschine nicht drum rum.

Dieser Sachverhalt ist vielen Marketingverantwortlichen, Entscheidern und Geschäftsführern bewusst, sodass in der deutschen Internetlandschaft die Suchmaschinenoptimierung bereits in unterschiedlichster Ausprägung angegangen wurde.

Wie diese Ausprägung nun genau aussieht, hat die Studie der Kölner Marketing Agentur mindshape GmbH herausfinden wollen. Erstmalig 2015 und wiederholt 2016 wurden 3513 Unternehmen aus ganz Deutschland hinsichtlich ihres Optimierungsgrades für Suchmaschinen und ihrer SEO-Potenziale untersucht.

Ergebnis der Studie ist unter anderem der Istzustand der Suchmaschinenoptimierung von deutschen Webseiten und die Entwicklung der Seiten von 2015 zu 2016. Der Fokus dieses Beitrages soll jedoch weniger auf diesen Erkenntnissen liegen. Vielmehr soll es im Folgenden um die Differenz zwischen Ist- und Sollzustand gehen. Mit anderen Worten: Welche SEO-Potenziale können deutsche Webseitenbetreiber im Jahr 2016 noch ausschöpfen.

Inhaltsübersicht

WICHTIGE FAKTOREN

SEO-POTENZIALE 2016 – DIE KRITERIEN

Als Spezialist für SEO Dresden und darüber hinaus müssen wir resümieren, dass es keinen allgemeingültigen Sollzustand gibt. Sucht man in den Weiten des Internets nach SEO Maßnahmen, findet man diverse Top X Rankings oder Anleitungen. Einige Punkte werden sich sicherlich wiederkehrend finden lassen – nach einem generellen Konsens sucht man jedoch vergebens.

Welche Zusammenstellung an Kriterien hat mindshape nun in der Studie seo-studie-mindex-2016 betrachtet, die in ihrer Gesamtheit das gesamte SEO-Potenzial abbilden sollen?

In der Studie wurden 34 Faktoren betrachtet, die den Bereichen Crawlability, Technik, Content, Offpage und Social Media zugeordnet werden können.

HILFSMITTEL FÜR CRAWLER

CRAWLABILITY

Unter dem Begriff Crawlability versteht man die Benutzerfreundlichkeit einer Webseite für die Suchmaschine. Damit ein Crawler eine Webseite leicht und schnell erfassen kann, sollte man ihm Hilfsmittel und Hinweise zur Verfügung stellen.

Anweisungen an den Crawler, wie sie in der robots.txt oder im Robot Meta Tag zu finden sind, sollten daher auf keiner Webseite fehlen. Sie sagen der Suchmaschine nämlich, welche Seite indexiert und welchen Links auf der Webseite gefolgt werden darf. Zusätzlich kann dem Crawler in der robot.txt auch die Adresse der XML-Sitemap mitgeteilt werden. Die XML-Sitemap gilt als eines der wichtigsten Hilfsmittel und zeigt dem Crawler die Verzeichnisstruktur, also den Aufbau der gesamten Website, an. Somit kann jede indexierte Seite ordnungsgemäß gefunden und auch erfasst werden.

RICHTIGE PROGRAMMIERUNG

TECHNISCHE SEO

Eine Website sollte nicht nur gut aussehen, sondern auch technisch einwandfrei programmiert sein. Um mögliche Fehlerquellen identifizieren zu können, sollte man Web Analytics Software, wie Google Analytics, auf der eigenen Website nutzen. Die gesammelten Nutzerdaten können ausgewertet und auf deren Basis SE Optimierungen durchgeführt werden. Aber auch andere, allgemeine Faktoren sind nicht zu unterschätzen.

Beispielsweise geht heutzutage die Mehrheit der Suchanfragen über mobile Geräte ein und dementsprechend sollte jede Website mit einem Responsive Design und passendem Viewport ausgestattet sein. Dadurch ist ein einheitliches Nutzererlebnis gewährleistet und keine gesonderte Mobilseite mehr erforderlich. Diesen Fakt sollten mittlerweile alle Webdesign Agenturen verinnerlicht haben.

Selbstverständlich sollte eine Website auch zeitgemäße Standards, wie HTML5 oder https, erfüllen. Diese stellen oftmals nützliche Funktionen zur Verfügung, die sowohl dem Unternehmen als auch den Kunden einen Mehrwert bieten.

Neben der Ladezeit als Ranking- und Usability-Faktor spielen auch korrekte http-Statuscodes, die Anzahl der Auszeichnungsfehler im Quelltext gemäß des W3C-Konsortiums sowie Microdaten eine wichtige Rolle.

DER INHALT ZÄHLT

CONTENT-MARKETING

Im Zusammenhang mit den Inhalten einer Webseite fällt oft das Zitat „Content is King“ und das trifft auch zu. Mit Content-Marketing gewinnt man nicht nur Kunden, sondern auch die Suchmaschine für sich. Während Kunden Informationen und Unterhaltung suchen, möchten die Crawler das Thema und die Relevanz einer Seite bestimmen.

Aus diesem Grund sollte man den textbasiert arbeitenden Suchmaschinen möglichst viele Informationen in einer strukturierten Form (se-optimiert) bereitstellen. Hilfsmittel sind die Title-Tags, die Meta Description, die h-Überschriften, Fettmarkierungen, Listen und Tabellen sowie das alt-Attribut bei Bildern. Der gesamte Content sollte nach Möglichkeit individuell verfasst worden sein, um einzigartige Informationen anzubieten und einen Mehrwert zu produzieren. Alles andere wäre nämlich auch Duplicate Content. Angaben, die die Suchmaschine verwendet, sind aber auch für den suchenden Kunden nützlich. Der Title-Tag beschriftet zum Beispiel den Tab des Browsers und die Meta Description liefert bereits auf der Suchergebnisseite einen Vorgeschmack auf den Inhalt der Webseite.

Weiterhin sind im heutigen Zeitalter auch eingebundene Medien nicht zu unterschätzen. Bilder und Videos sind nicht nur für den Kunden eine schöne Abwechslung, sondern werden auch von den Suchmaschinen positiv bewertet.

Mindestens genauso wichtig ist eine gute interne und externe Verlinkung. Jede Seite sollte den Kunden auf andere Seiten weiterleiten, die ihm bei der Kaufentscheidung helfen oder einen sonstigen Mehrwert bieten. Außerdem folgen die Suchmaschinen den Links und können so auch Unterseiten finden, die vielleicht nicht direkt über die Navigationsleisten aufrufbar wären.

WICHTIGE LINKS SETZEN

OFFPAGE-OPTIMIERUNG

Eingehende Links von anderen Domains werden von den Suchmaschinen als Empfehlung für die eigene Seite angesehen und aus diesem Grund in das Ranking einbezogen. Man sollte daher versuchen, möglichst viele Backlinks von unterschiedlichen Domains zu erhalten, um von Google und Co. als wichtig wahrgenommen zu werden. Doch Vorsicht: Qualität geht vor Quantität! Verlinkungen von Seiten, mit denen man lieber nicht in Verbindung gebracht werden sollte, werden von den Suchmaschinen negativ bewertet. Das gilt auch für hohe Linkzuwachsraten innerhalb kürzester Zeit, weil dann eine Manipulation durch Linkeinkäufe oder Ähnliches vermutet wird. Natürlicher Linkaufbau sollte also immer der einzige Weg zu guten Backlinks sein.

VERNETZUNG NACH AUSSEN

SOCIAL MEDIA

Im heutigen Zeitalter ist die Kommunikation mit Kunden in sozialen Netzwerken Pflicht. Wer dort als Unternehmen nicht auftritt, verschenkt enormes Marketing-Potential und kann sogar negative Folgen erleiden. Denn nur weil ein Unternehmen nicht in den sozialen Netzwerken vertreten ist, heißt es nicht, dass die Kunden dort nicht über die Produkte reden. Aus diesem Grund sollte man Social Media Marketing für sich nutzen und die Diskussionen der Kunden in die richtige Richtung lenken sowie Content auf den entsprechenden Plattformen bereitstellen.

Aber auch bei der Suchmaschinenoptimierung spielt Social Media eine nicht zu unterschätzende Rolle. Die Anzahl der sogenannten Social Signals – das sind Likes, Shares und Kommentare – nutzen Suchmaschinen, um die Relevanz von Content zu bewerten. Dafür müssen aber Facebook, Twitter und Co. erst einmal auf der Website eingebunden werden, sodass die Kunden anschließend Empfehlungen für Produkte oder Content abgeben können.

WAS KAM RAUS?

SEO-POTENZIALE 2016 – DIE ERGEBNISSE

Als Spezialist für Suchmaschinenoptimierung und darüber hinaus müssen wir resümieren, dass es keinen allgemeingültigen Sollzustand gibt. Sucht man in den Weiten des Internets nach SEO Maßnahmen, findet man diverse Top X Rankings oder Anleitungen. Einige Punkte werden sich sicherlich wiederkehrend finden lassen – nach einem generellen Konsens sucht man jedoch vergebens.

Welche Zusammenstellung an Kriterien hat mindshape nun in der Studie seo-studie-mindex-2016 betrachtet, die in ihrer Gesamtheit das gesamte SEO-Potenzial abbilden sollen?

In der Studie wurden 34 Faktoren betrachtet, die den Bereichen Crawlability, Technik, Content, Offpage und Social Media zugeordnet werden können.

CRAWLABILITY RUTSCHT AB

CRAWLABILITY STARK VERNACHLÄSSIGT

Zwar können knapp 60% der Unternehmenswebsites eine robots.txt aufweisen, die dem Crawler grundlegende Anweisungen zur Indexierung und Linkverfolgung mitgibt, aber lediglich ein Fünftel bietet auch eine XML-Sitemap zur verbesserten Seitennavigation an. Durch den Verzicht auf die Nutzung dieser beiden Hilfsmittel wird bereits viel Potential verschenkt und der Suchmaschine das Crawling nur unnötig erschwert. Dabei ist die Seitenerfassung durch den Crawler doch die Grundlage für die weiterführende Suchmaschinenoptimierung.

POTENZIALE NOCH NICHT GANZ AUSGESCHÖPFT

TECHNIK, DIE BEGEISTERT?

Im Allgemeinen sind die Websites im Bereich der Technik in einem guten Zustand. Erträgliche, kurze Ladezeiten sowie meistens korrekt ausgegebene http-Statuscodes sprechen zumindest dafür. Weiterhin sind circa 30% der Seiten mit einem Responsive Design und HTML5 ausgestattet und die Entwicklung lässt darauf hoffen, dass diese Werte bis zum nächsten Jahr noch einmal kräftig steigen.

Aber auch im Teilbereich Technik gibt es ungenutzte SEO-Potenziale. So werden kaum verschlüsselte Verbindungen zwischen Server und Client mittels https verwendet und das, obwohl Vertraulichkeit und Datenintegrität eine hohe Priorität haben sollten. Ebenso verzichten fast 90% der Unternehmen auf die Verwendung von Microdaten, die auf der Suchergebnisseite besonders informative Rich Snippets erzeugen und welche meist zu höheren Klickraten führt.

Immerhin nutzt die Hälfte der Websites Analytics Software und kann damit in Zukunft Probleme besser identifizieren und darauf gezielt mit Optimierungen reagieren.

WO BLEIBT DER CONTENT?

CONTENT IST (NOCH) KEIN KING

Die Erfassung der Einzigartigkeit und des Nutzens der Inhalte ist im Rahmen einer so umfangreichen Studie natürlich nur schwer erfassbar. Trotzdem lassen sich zahlreiche Schlüsse über gute und schlechte Entwicklungen im Bereich Content ziehen.

Positiv zu bemerken ist, dass die Menge des Textes auf den Seiten leicht gestiegen ist, die Anzahl interner und externer Verlinkungen sich im grünen Bereich befindet und auch Medien in Form von Bildern und Videos genutzt werden.

Allerdings überwiegen die negativen Aspekte die positiven bei Weitem. Title-Tags und Meta Description fehlen gern einmal auf den Seiten und falls sie vorhanden sind, ist der Grad der Unterschiedlichkeit viel zu gering. Letzteres ist leider ein Zeichen für Duplicate Content und der wird von Google negativ ins Ranking einbezogen.

Außerdem steht den Suchmaschinen mit durchschnittlich 223 Wörtern pro Seite immer noch zu wenig Inhalt zur Verfügung. Einerseits kann das Thema der Seite so nur schwer bestimmt werden und andererseits sind die Texte mit großer Sicherheit nicht sehr informativ. Weiterhin stellen oftmals fehlende alt-Attribute bei Bildern ein Problem dar, weil die Crawler Bildinhalte noch nicht selbst bestimmen können und ihnen diese Informationen dann fehlen.

Auch bei der Strukturierung sind so einige Mängel zu finden. Die h-Überschriften werden gar nicht oder oft falsch gesetzt und andere Strukturierungsmerkmale sind ebenfalls eher Seltenheit.

Durch die Nutzung elementarer HTML-Elemente könnte das Optimierungspotential bereits gut ausgeschöpft werden. Zusätzlich müssen in Zukunft einfach mehr hochwertige Inhalte bereitgestellt werden, die auf die Suchanfragen der potentiellen Kunden ausgerichtet sind.

FOKUS AUF OFFPAGE-OPTIMIERUNG

OFFPAGE WIRD (ZU)GUT GENUTZT

Backlinks gelten als wichtiges Rankingkriterium und die durchschnittliche Domain-Popularität ist mit 177 unterschiedlichen Domains gegenüber 2015 leicht gestiegen. Natürlich ist die notwendige Zahl der Bachlinks stark von der Branche und dem dort vorherrschenden Wettbewerb abhängig, aber insgesamt macht die Entwicklung einen guten Eindruck. Als Unternehmen sollte man also hier weiter an einem natürlichen und qualitativ hochwertigen Linkaufbau arbeiten, um die eigene Position zu stärken. Es gibt leider aber auch noch eine Reihe von Website- und Webshopbetreiber, die selbst oder denen SEO-Agentur weiterhin auf minderwertigen, quantitativen Backlinkaufbau setzt. Hier ist Vorsicht geboten!

KEINE VERNETZUNG

SOCIAL MEDIA IST NOCH NICHT IN DEN UNTERNEHMEN ANGEKOMMEN

Der Teilbereich Social Media schneidet mit Abstand am Schlechtesten ab. Noch nicht einmal die Hälfte aller Websites haben Facebook auf Ihrer Startseite verlinkt, bei den anderen sozialen Netzwerken – Karrierenetzwerke eingeschlossen – sieht es sogar noch schlechter aus. Somit wird nicht nur der direkte Dialog zwischen Kunden, potentiellen Mitarbeitern und dem Unternehmen verhindert, sondern auch das digitale Empfehlungsmarketing erheblich erschwert. Das Potential sollte dringend genutzt werden, um Social Signals zu generieren und den Suchmaschinen damit die Relevanz der eigenen Seite und Inhalte klarzumachen.

SEO NACH WIE VOR UNERLÄSSLICH FÜR UNTERNEHMEN

SEO-POTENZIALE 2016 – DAS FAZIT

Im Vergleich zum Vorjahr ist der Optimierungsgrad gestiegen und an den Entwicklungen sieht man, dass sich die Unternehmenswebsites nach und nach an die Trends zum Responsive Webdesign, HTML5-Standard und Content-Marketing anpassen. Allerdings werden einige Rankingkriterien zu stark vernachlässigt oder die Optimierung geschieht zu langsam, sodass gute Plätze in den Suchergebnissen verschenkt werden.

Aus diesem Grund sollte man zumindest die einmalige Suchmaschinenoptimierung an der Website durchführen, um eine gute Ausgangsbasis für ein Ranking in den Suchergebnissen zu erhalten. Für ausgezeichnete und dauerhafte Erfolge wird natürlich auch in Zukunft eine langfristige Suchmaschinenoptimierung kombiniert mit einem umfassenden Content-Marketing notwendig sein.

Haben Sie selbst das Gefühl, noch zu viel SEO-Potential zu verschenken? Als Agentur für professionelle Suchmaschinenoptimierung beraten wir Sie gern und helfen Ihnen bei der Optimierung Ihrer Website. So können auch Sie in Zukunft richtig gefunden werden!

Wobei dürfen unsere Experten Sie unterstützen?

- SEO-POTENZIALE 2016 – WELCHE POTENZIALE SCHLUMMERN AUF IHRER WEBSITE?

- SEO-POTENZIALE 2016 – DIE KRITERIEN

- CRAWLABILITY

- TECHNISCHE SEO

- CONTENT-MARKETING

- OFFPAGE-OPTIMIERUNG

- SOCIAL MEDIA

- SEO-POTENZIALE 2016 – DIE ERGEBNISSE

- CRAWLABILITY STARK VERNACHLÄSSIGT

- TECHNIK, DIE BEGEISTERT?

- CONTENT IST (NOCH) KEIN KING

- OFFPAGE WIRD (ZU)GUT GENUTZT

- SOCIAL MEDIA IST NOCH NICHT IN DEN UNTERNEHMEN ANGEKOMMEN

- SEO-POTENZIALE 2016 – DAS FAZIT